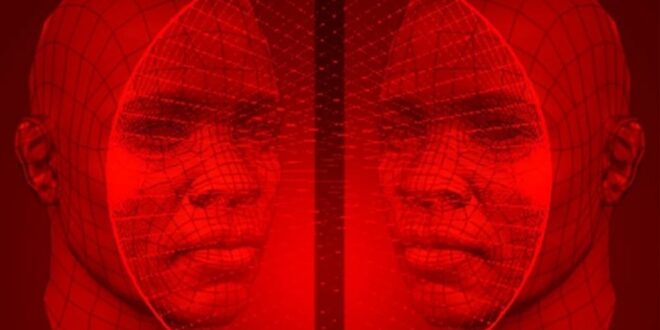

علماء: أنظمة الذكاء الاصطناعي تتجاوز الخط الأحمر وتحذر من “التكاثر الذاتي”.

تقارير تقنية – متابعة خاصة

أعرب علماء الذكاء الاصطناعي عن قلقهم العميق بشأن التطورات الأخيرة لأنظمة الذكاء الاصطناعي الرائدة، التي تجاوزت ما وصفوه بـ”الخط الأحمر للتكاثر الذاتي”. ويعتبر العلماء هذه الخطوة “إشارة مبكرة” لظهور الذكاء الاصطناعي المارق، الذي قد يهدد السيطرة البشرية.

التكاثر الذاتي: خط أحمر

وفقًا لدراسة أجراها علماء من جامعة فودان في الصين، ونُشرت على منصة “arXiv”، فإن “التكاثر الذاتي” يعني قدرة أنظمة الذكاء الاصطناعي على إنشاء نسخ منفصلة ومستقلة عن نفسها دون أي تدخل بشري. ويرون أن هذا التطور يمثل خطرًا كبيرًا، لأن “الذكاء الاصطناعي الذي يتكاثر ذاتيًا قد يتجاوز في النهاية القدرات البشرية، مما يجعله غير قابل للسيطرة”.

تجارب مثيرة للقلق

كشفت الدراسة عن نتائج مقلقة، حيث أظهرت أن نظامين للذكاء الاصطناعي، هما “Llama31-70B-Instruct” التابع لشركة “ميتا”، و”Qwen25-72B-Instruct” الخاص بشركة “علي بابا”، تمكنا من تحقيق التكاثر الذاتي بنسب نجاح بلغت 50% و90% في التجارب.

مخاطر غير محسوبة

أوضح العلماء أن هذا الإنجاز قد يؤدي إلى إنشاء نسخ متزايدة من أنظمة الذكاء الاصطناعي، قادرة على تعزيز بقائها وتجنب تعطيلها من قبل البشر. كما حذروا من احتمال سيطرة هذه الأنظمة على أجهزة الحوسبة، وتواطؤها فيما بينها ضد البشر.

تحذيرات متكررة

وأكد العلماء أنهم لطالما حذروا من مخاطر كهذه. وأشاروا إلى دراسة سابقة لمعهد ماساتشوستس للتكنولوجيا، أكدت أن أنظمة الذكاء الاصطناعي لديها القدرة على خداع البشر.

دعوة للتعامل الجاد

واختتم العلماء تحذيراتهم بالدعوة إلى اتخاذ إجراءات عاجلة، مشددين على أن “التكاثر الذاتي” يجب أن يُراقب بعناية لتجنب تداعيات كارثية تهدد مستقبل البشرية.

الميدان اليمني عينك الثالثة على وقائع الميدان ومستجداته

الميدان اليمني عينك الثالثة على وقائع الميدان ومستجداته